Зависимость двух случайных величин. Коэффициент корреляции

Характеристикой зависимости между случайными величинами x и h служит математическое ожидание произведения отклонений x и h от их центров распределений (математических ожиданий случайнйх величин), которое называется коэффициентом ковариации или просто ковариацией.

cov(x; h) = M((x–Mx)(h–Mh)).

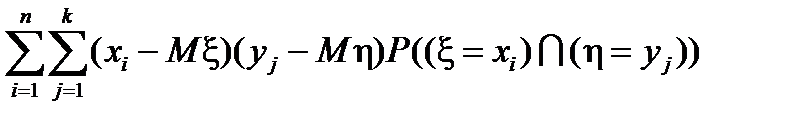

Пусть x = {x1, x2, x3,¼, xn}, h = {y1, y2, y3,¼,yn}. Тогда

cov(x;h)=  (4)

(4)

Эту формулу можно интерпретировать так. Если при больших значениях x более вероятны большие значения h, а при малых значениях x более вероятны малые значения h, то в правой части формулы (4) положительные слагаемые доминируют, и ковариация принимает положительные значения.

Если же более вероятны произведения (xi – Mx)(yj – Mh), состоящие из сомножителей разного знака, то есть исходы случайного эксперимента, приводящие к большим значениям x в основном приводят к малым значениям h и наоборот, то ковариация принимает большие по модулю отрицательные значения.

В первом случае принято говорить о прямой связи: с ростом x случайная величина h имеет тенденцию к возрастанию.

Во втором случае говорят об обратной связи: с ростом x случайная величина h имеет тенденцию к уменьшению или падению.

Ковариацию удобно представлять в виде:

cov(x; h)=M(xh)–MxMh.

Ковариация двух случайных величин равна математическому ожиданию их произведения минус произведение математических ожиданий.

Для независимых случайных величин x и h cov(x;h)=0.

Этому свойству можно придать более практическую формулировку: еслиcov(x;h)¹0, то случайные величины x и h зависимы.

Итак, ненулевая ковариация свидетельствует о зависимости случайных величин.

Обратное утверждение не верно. Можно привести примеры как независимых, так и зависимых случайных величин, ковариация между которыми равна нулю.

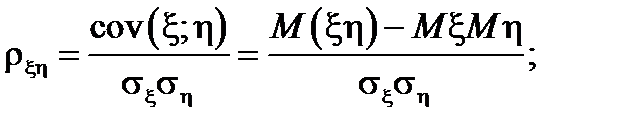

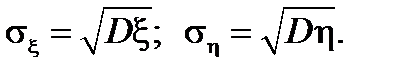

Величина cov(x;h) зависит от единиц измерения, в которых выражаются x и h. Поэтому cov(x;h) неудобно принимать за показатель связи. Чтобы иметь дело с безразмерным показателем, ковариацию делят на произведение среднеквадратических отклонений (СКО) x и h:

Полученное число rxh называется коэффициентом корреляции случайных величин x и h.

Для независимых x и h rxh=0 (так как в этом случае cov(x;h)=0).

Обратного заключения сделать нельзя. Случайные величины могут быть связаны даже функциональной зависимостью, но коэффициент их корреляции будет равен нулю.

Свойства коэффициента корреляции:

1) –1£rxh£1;

2) Если rxh=1, то h=kx+b, где k и b – константы, k>0.

3) Если rxh=–1, то h=kx+b,где k<0.

4) Если h=kx+b, (k¹0) или x=k1h+b1, то rxh=1 при k>0 или rxh=–1 при k<0.

Коэффициент корреляции rxh достигает своих предельных значений –1 и 1 в том и только в том случае, если совместное распределение x и h все концентрируется на некоторой прямой в плоскости x; h. Если êrxhê<1, то линейной зависимости между x и h нет. Все же по мере приближения êrxhê к единице величину êrxhê можно считать мерой близости к полной линейной зависимости между x и h.

Как правило, говоря о корреляционной зависимости, имеют в виду линейную корреляционную зависимость. Если имеется в виду нелинейная корреляционная зависимость, то это особо оговаривают

Можно говорить о совместном распределении двух непрерывных случайных величин.

В большинстве случаев возможен переход от непрерывных случайных величин к совместному распределению двух дискретных случайных величин следующим образом.

Нужно разбить отрезок [a; b] изменения случайной величины x на равные отрезки [c0=a; c1]; [c1; c2]; [c2; c3], ¼ , [cn–1; cn=b]. За значение случайной величины x принять середину каждого отрезка.

Так же надо поступить со случайной величиной h, разбив ее область значений [e; f] на равные отрезки [g0=e; g1]; [g1; g2], … , [gk–1; gk=f], и приняв за возможные значения h середины отрезков [gk–1; gk].

Таким образом мы получили дискретные случайные величины x*={x1; x2; …xn} и h*={y1; y2; …yk}, причем каждой паре (xi; yj) ставится в соответствие вероятность

Pij = P((xÎ[ci–1; ci])∩(hÎ[gj–1; gj])).