Оценка тесноты связи: коэффициент корреляции, индекс корреляции, коэффициенты эластичности и детерминации

Наряду с построением уравнения регрессии осуществляется оценка тесноты связи

между явлениями (между переменными).

Тесноту связи в случае линейной зависимости характеризуют с помощью

выборочного коэффициента корреляции rxy

rxy - коэффициент парной корреляции (-1£ rxy£1)

Выборочный коэффициент корреляции rxy связан с коэффициентом линейной регрессии b соотношением

Чем ближе величина rxy к единице, тем теснее линейная связь и тем лучше линейная зависимость согласуется с данными наблюдений. При rxy = 1 связь становится функциональной, т. е. соотношение  выполняется для всех наблюдений.

выполняется для всех наблюдений.

При rxy > 0 связь является прямой, при rxy < 0 – обратной.

Уравнение нелинейной регрессии, также как и в линейной зависимости дополняется показателем тесноты связи между переменными  , а именно индексом корреляцииR

, а именно индексом корреляцииR

.

.

Величина данного показателя находится в границах  ; чем ближе к единице, тем теснее связь рассматриваемых признаков, тем более надежно найденное уравнение регрессии.

; чем ближе к единице, тем теснее связь рассматриваемых признаков, тем более надежно найденное уравнение регрессии.

В экономических исследованиях широкое применение находит такой показатель, как коэффициент эластичности, в частности, средний коэффициент эластичности.

Средний коэффициент эластичности  показывает, на сколько процентов в среднем по совокупности значений фактора х изменится результат y от своей средней величины при изменении фактора x на 1%:

показывает, на сколько процентов в среднем по совокупности значений фактора х изменится результат y от своей средней величины при изменении фактора x на 1%:

Для линейной функции:

Суммарной мерой общего качества уравнения регрессии (соответствия уравнения

регрессии статистическим данным) является коэффициент детерминации R2.

В случае парной регрессии коэффициент детерминации будет совпадать с квадратом коэффициента корреляции:

.

.

В общем случае коэффициент детерминации рассчитывается по формуле:

(3.12)

(3.12)

Поясним смысл коэффициента детерминации. Пусть эмпирическое уравнение регрессии имеет вид:

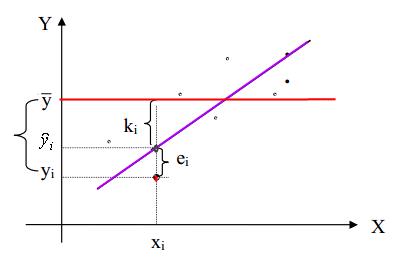

Тогда наблюдаемые (реальные) значения уi, i = 1, 2, … , n, отличаются от модельных yi на величину ei:

Последнее соотношение можно переписать в следующем виде:

(*)

(*)

где  − отклонение i-й (наблюдаемой) точки от среднего значения

− отклонение i-й (наблюдаемой) точки от среднего значения  зависимой переменной Y;

зависимой переменной Y;

− отклонение i-й точки на линии регрессии от

− отклонение i-й точки на линии регрессии от  ;

;

− отклонение i-й точки от модельного значения

− отклонение i-й точки от модельного значения  , определяемого по линии регрессии.

, определяемого по линии регрессии.

Все отклонения рассчитываются по оси зависимой переменной (см. рис. 3.3).

Рис.3.3.

Возведем обе части равенства (*) в квадрат и просуммируем полученные значения по объему выборки n:

Можно показать, что  (доказательство опускаем для упражнения). Тогда справедливо следующее соотношение:

(доказательство опускаем для упражнения). Тогда справедливо следующее соотношение:

(3.13)

(3.13)

Очевидно, что

− общая (полная) сумма квадратов (может интерпретироваться как мера общего разброса (рассеивания) переменной Y относительно

− общая (полная) сумма квадратов (может интерпретироваться как мера общего разброса (рассеивания) переменной Y относительно  ). (TSS)

). (TSS)

− объясненная сумма квадратов, интерпретируемая как мера разброса, объяснимого с помощью регрессии. (ESS)

− объясненная сумма квадратов, интерпретируемая как мера разброса, объяснимого с помощью регрессии. (ESS)

− остаточная (необъясненная) сумма квадратов, являющаяся мерой остаточного, необъясненного уравнением регрессии разброса (разброса точек вокруг линии регрессии). (RSS)

− остаточная (необъясненная) сумма квадратов, являющаяся мерой остаточного, необъясненного уравнением регрессии разброса (разброса точек вокруг линии регрессии). (RSS)

Разделив (3.13) на левую его часть, получим:

.

.

Вводя обозначение  , получаем соотношение (3.12). При этом очевидно, что коэффициент детерминации R2 определяет долю разброса зависимой переменной, объяснимую регрессией Y на X.

, получаем соотношение (3.12). При этом очевидно, что коэффициент детерминации R2 определяет долю разброса зависимой переменной, объяснимую регрессией Y на X.

определяет долю разброса зависимой переменной, необъясненную регрессией Y на X.

определяет долю разброса зависимой переменной, необъясненную регрессией Y на X.

Из проведенных рассуждений следует, что в общем случае справедливо соотношение 0 ≤ R2≤ 1.

Коэффициент детерминации R2 является мерой, позволяющей определить, в какой степени найденная прямая регрессии дает лучший результат для объяснения поведения зависимой переменной Y, чем горизонтальная прямая Y =  .

.

Следовательно, чем теснее линейная связь между Х и Y, тем ближе коэффициент детерминации R2 к единице. Чем слабее такая связь, тем R2 ближе к нулю.