Лекция 6 Множественный регрессионный анализ

Регрессионный анализ предназначен для исследования зависимости исследуемой переменной от различных факторов и отображения их взаимосвязи в форме регрессионной модели [3].

В регрессионных моделях зависимая (объясняемая) переменная Y может быть представлена в виде функции f (X1, X2, X3, … Xm), где X1, X2, X3, … Xm - независимые (объясняющие) переменные, или факторы. В качестве зависимой переменной может выступать практически любой показатель, характеризующий, например, функционирование сложной системы, деятельность предприятия или курс ценной бумаги. В зависимости от вида функции f (X1, X2, X3, … Xm) модели делятся на линейные и нелинейные. В зависимости от количества включенных в модель факторов Х модели делятся на однофакторные (парная модель регрессии) и многофакторные (модель множественной регрессии).

Связь между переменной Y и m независимыми факторами можно охарактеризовать функцией регрессии Y= f (X1, X2, X3, … Xm), которая показывает, каково будет в среднем значение переменной y, если переменные xi примут конкретные значения.

Данное обстоятельство позволяет использовать модель регрессии не только для анализа, но и для прогнозирования процессов и результатов деятельности организаций.

Линейная модель множественной регрессии имеет вид:

Y i = a0 + a1x i 1+a2x i 2+…+ am x i m + ei ,  . (1)

. (1)

коэффициент регрессии aj показывает, на какую величину в среднем изменится результативный признак Y, если переменную xj увеличить на единицу измерения. Обычно предполагается, что случайная величина ei имеет нормальный закон распределения с математическим ожиданием равным нулю и с дисперсией  .

.

Анализ уравнения (1) и методика определения параметров становятся более наглядными, а расчетные процедуры существенно упрощаются, если воспользоваться матричной формой записи уравнения (1):

Y = X a + e, (2)

где Y - вектор зависимой переменной размерности п ´ 1, представляющий собой п наблюдений значений уi;Х- матрица п наблюдений независимых переменных X1, X 2, X 3 , … X m, размерность матрицыХ равна п ´(т+1); a— подлежащий оцениванию вектор неизвестных параметров размерности (т+1)´1;e-вектор случайных отклонений размерности п ´1.

Уравнение (1) содержит значения неизвестных параметров a0, a1, a2,… ,am. Эти величины оцениваются на основе выборочных наблюдений, поэтому полученные расчетные показатели не являются истинными, а представляют собой лишь их статистические оценки. Модель линейной регрессии, в которой вместо истинных значений параметров подставлены их оценки (а именно такие регрессии и применяются на практике), имеет вид:

Y =Ха + е=  +е, (3)

+е, (3)

где а- вектор оценок параметров; е - вектор «оцененных» отклонений регрессии, остатки регрессии е = Y - Ха;  - оценка значений Y, равнаяХа.

- оценка значений Y, равнаяХа.

Параметры модели множественной регрессии можно оценить с помощью метода наименьших квадратов. Формула для вычисления параметров регрессионного уравнения имеет вид:

a = (Xт X )-1 X т Y (4)

Одним из условий регрессионной модели является предположение о линейной независимости объясняющих переменных, т.е., решение задачи возможно лишь тогда, когда столбцы и строки матрицы исходных данных линейно независимы. Это условие выполняется не всегда. Линейная или близкая к ней связь между факторами называется мультиколлинеарностью и приводит к линейной зависимости нормальных уравнений, что делает вычисление параметров либо невозможным, либо затрудняет содержательную интерпретацию параметров модели.

Мультиколлинеарность может возникать в силу разных причин. Например, несколько независимых переменных могут иметь общий временной тренд, относительно которого они совершают малые колебания. Считают явление мультиколлинеарности в исходных данных установленным, если коэффициент парной корреляции между двумя переменными больше 0,8. Чтобы избавиться от мультиколлинеарности, в модель включают лишь один из линейно связанных между собой факторов, причем тот, который в большей степени связан с зависимой переменной.

Качество модели регрессии оценивается по следующим направлениям:

1) проверка качества всего уравнения регрессии;

2) проверка значимости всего уравнения регрессии;

3) проверка статистической значимости коэффициентов уравнения регрессии;

4) проверка выполнения предпосылок МНК.

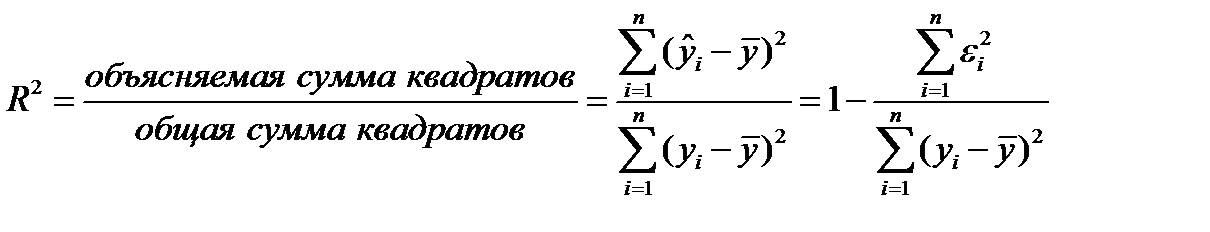

Для оценки качества модели множественной регрессии вычисляют коэффициент множественной корреляции (индекс корреляции) R икоэффициент детерминацииR2:

, (5)

, (5)

где у - фактическое значение зависимой переменной; y^- рассчитанное по уравнению регрессии значение зависимой переменной; y— - среднее арифметическое значение переменной у.

Чем ближе к единице значение этих характеристик, тем выше качество модели.

В многофакторной регрессии добавление дополнительных объясняющих переменных увеличивает коэффициент детерминации. Следовательно, коэффициент детерминации должен быть скорректирован с учетом числа независимых переменных. Скорректированный R2, или  , рассчитывается так:

, рассчитывается так:

, (6)

, (6)

где n - число наблюдений; k -число независимых переменных.

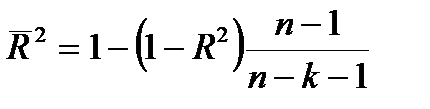

Проверка значимости модели регрессии

Для проверки значимости модели регрессии используется F-критерий Фишера, вычисляемый по формуле:

(7)

(7)

Если расчетное значение с n1= к и n2 = (n - k - 1) степенями свободы, где k – количество факторов, включенных в модель, больше табличного при заданном уровне значимости, то модель считается значимой.

Анализ статистической значимости параметров модели

значимость отдельных коэффициентов регрессии проверяется по t-статистике путем проверки гипотезы о равенстве нулю j-го параметра уравнения (кроме свободного члена):

taj =  / Saj , (8)

/ Saj , (8)

где Saj - стандартное (среднеквадратическое) отклонение коэффициента уравнения регрессии aj.Величина Saj представляет собой квадратный корень из произведения несмещенной оценки дисперсии  и j-го диагонального элемента матрицы, обратной матрице системы нормальных уравнений.

и j-го диагонального элемента матрицы, обратной матрице системы нормальных уравнений.

Saj =  ´

´  , (9)

, (9)

где bjj - диагональный элемент матрицы (ХТ Х)-1.

Если расчетное значение t-критерия с (n - k - 1) степенями свободы превосходит табличное значение при заданном уровне значимости, коэффициент регрессии считается значимым. В противном случае фактор, соответствующий этому коэффициенту, следует исключить из модели, при этом оставшиеся в модели параметры должны быть пересчитаны.

Проверка выполнения предпосылок МНК

Проверка выполнения предпосылок МНК выполняется на основе анализа остаточной компоненты. Согласно общим предположениям регрессионного анализа, остатки должны вести себя как независимые (в действительности, почти независимые) одинаково распределенные случайные величины. В классических методах регрессионного анализа предполагается также нормальный закон распределения остатков.

Исследование остатков полезно начинать с изучения их графика. 0н может показать наличие какой-то зависимости, не учтенной в модели. График остатков может так же показать необходимость перехода к нелинейной модели (квадратичной, полиномиальной, экспоненциальной) или включения в модель периодических компонент.

График остатков показывает и резко отклоняющиеся от модели наблюдения - выбросы. Подобным аномальным наблюдениям надо уделять особо пристальное внимание, так как их присутствие может искажать значения оценок. Устранение выбросов может проводиться либо с помощью удаления этих точек из анализируемых данных, (эта процедура называется цензурированием), либо с помощью применения методов оценивания параметров, устойчивых к подобным грубым отклонениям.

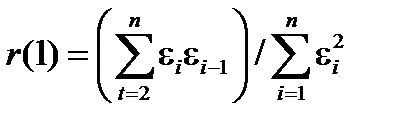

Независимость остатков можно проверить расчетом первого коэффициента автокорреляции:

. (10)

. (10)

Для принятия решения о наличии или отсутствии автокорреляции в исследуемом ряду фактическое значение коэффициента автокорреляции r(1) сопоставляется с критическим значением для 5%-ного уровня значимости (вероятности допустить ошибку при принятии нулевой гипотезы о независимости уровней ряда). Если фактическое значение коэффициента автокорреляции меньше табличного, то гипотеза об отсутствии автокорреляции в ряду может быть принята, а если фактическое значение больше табличного – делают вывод о наличии автокорреляции в ряду динамики.

Обнаружение гетероскедастичности

Для обнаружения гетероскедастичности обычно используют три теста, в которых делаются различные предположения о зависимости между дисперсией случайного члена и объясняющей переменной: тест ранговой корреляции Спирмена, тест Голдфельда-Квандта и тест Глейзера [Доугерти].

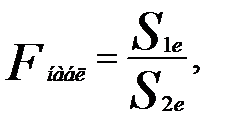

При малом объеме выборки для оценки гетероскедастичности может использоваться метод Голдфельда - Квандта.

Данный тест используется для проверки такого типа гетероскедастичности, когда дисперсия остатков возрастает пропорционально квадрату фактора. При этом делается предположение, что, случайная составляющая  распределена нормально.

распределена нормально.

Чтобы оценить нарушение гомоскедастичности по тесту Голдфельда - Квандта необходимо выполнить следующие шаги:

1) Упорядочение п наблюдений по мере возрастания переменной х.

2) Разделение совокупности на две группы (соответственно с малыми и большими значениями фактора х) и определение по каждой из групп уравнений регрессии.

3) Определение остаточной суммы квадратов для первой регрессии

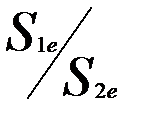

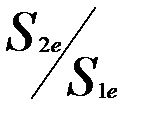

4) Вычисление отношений  (или

(или  ). В числителе должна быть большая сумма квадратов.

). В числителе должна быть большая сумма квадратов.

Полученное отношение имеет F распределение со степенями свободы k1=n1-m и k2=n-n1-m, (m – число оцениваемых параметров в уравнении регрессии).

Если  то гетероскедастичность имеет место, нарушена предпосылка о равенстве дисперсий остаточных величин.

то гетероскедастичность имеет место, нарушена предпосылка о равенстве дисперсий остаточных величин.

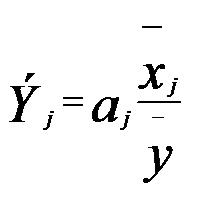

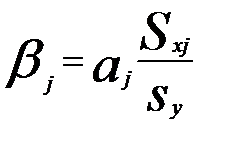

Важную роль при оценке влияния факторов играют коэффициенты регрессионной модели. Однако непосредственно с их помощью нельзя сопоставить факторы по степени их влияния на зависимую переменную из-за различия единиц измерения и разной степени колеблемости. Для устранения таких различий при интерпретации применяются средние частные коэффициенты эластичности Э (j) и бета-коэффициенты b (j), которые рассчитываются по формулам:

(11)

(11)

(12)

(12)

где Sxj , Sy - среднеквадратическое отклонение соответственно фактора xj и зависимой переменной у.

Коэффициент эластичности показывает, на сколько процентов изменяется зависимая переменная при изменении фактораxj на один процент. Однако он не учитывает степень колеблемости факторов.

Бета-коэффициент показывает, на какую часть величины среднего квадратического отклонения Sy изменится зависимая переменная y с изменением соответствующей независимой переменной xj на величину своего среднеквадратического отклонения при фиксированном на постоянном уровне значении остальных независимых переменных.

Указанные коэффициенты позволяют упорядочить факторы по степени их влияния на зависимую переменную.

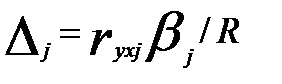

Долю влияния фактора xj в суммарном влиянии всех факторов можно оценить по величине дельта - коэффициентов:

(13)

(13)

где  - коэффициент парной корреляции между фактором xj (j = 1,...,m) и зависимой переменной y.

- коэффициент парной корреляции между фактором xj (j = 1,...,m) и зависимой переменной y.

Одна из важнейших целей моделирования заключается в прогнозировании поведения исследуемого объекта. При использовании построенной модели для прогнозирования делается предположение о сохранении в период прогнозирования существовавших ранее взаимосвязей переменных.

Для того чтобы определить область возможных значений результативного показателя, при рассчитанных значениях факторов следует учитывать два возможных источника ошибок: рассеивание наблюдений относительно линии регрессии и ошибки, обусловленные математическим аппаратом построения самой линии регрессии. Ошибки первого рода измеряются с помощью характеристик точности, в частности, величиной Sy. Ошибки второго рода обусловлены фиксацией численного значения коэффициентов регрессии, в то время как они в действительности являются случайными, нормально распределенными.

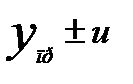

Различают два вида прогноза – точечный прогноз и интервальный прогноз. Точечный прогноз зависимой переменной yпр вычисляют с помощью уравнения регрессии подстановкой в него прогнозируемые значения факторных переменных. Интервальный прогноз зависимой переменной учитывает отклонения прогнозных значений от линии регрессии  .

.

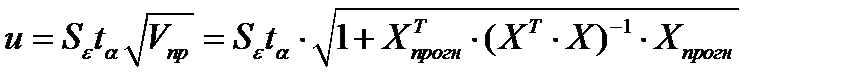

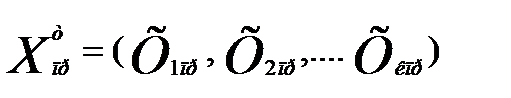

Для линейной модели регрессии доверительный интервал прогнозирования рассчитывается следующим образом:

(14)

(14)

где  - прогнозное значение факторных переменных.

- прогнозное значение факторных переменных.

Контрольные вопросы

1. Для чего может использоваться модель регрессии?

2. К чему приводит мультиколлинеарность факторных переменных при регрессионном анализе?

3.Что характеризуют коэффициенты регрессии?

4. Как оценивается значимость коэффициентов модели регрессии?

5. Как проверяется адекватность модели регрессии?

6. Что характеризует коэффициент детерминации?

7. По каким направлениям оценивается качество модели регрессии?

8. Как оценивается влияние отдельных факторов на зависимую переменную на основе модели?

9. Как проверяется выполнение предпосылок МНК?

10. Как прогнозируется поведение исследуемого объекта. Понятие точечного и интервального прогноза?

Лекция 7 Особенности планирования промышленного

Эксперимента

Промышленный объект исследования можно представить нижеприведенной схемой (рис.1) [4]. Независимые (факторные) переменные x10, x20, ..xk0 регистрируются с погрешностью измерений ei , i=1, 2, ..k. Зависимая переменная «y» «зашумлена» под влиянием неучтенных возмущающих воздействий d1, d2, ..ds. Эквивалентный шум, приведенный к выходной переменной, представляет случайную величину, обозначен переменной «е».

| + |

| + |

| d1 |

| ds |

| e |

| y |

| X01 |

| X0k |

| ek |

| X0k |

| Xk |

| ОБЪЕКТ |

Рисунок 1 – Схема промышленного эксперимента по статистическому

описанию объекта в режиме нормального функционирования

Таким образом, при разработке модели регрессии, экспериментатор использует не точную информацию. Ниже рассматривается влияние погрешностей измерения входных и выходных переменных на точность коэффициентов регрессии и качество модели. Полагаем, что объект описывается линейной регрессионной моделью.

Допущения:

1) xi, i=1, 2, ..k – нормально распределенный стационарный случайный процесс, обладает свойством эргодичности;

2) d1- ds – возмущающие воздействия, независимые случайные процессы с нулевым математическим ожиданием, среди которых нет доминирующих. Не коррелированны с входными переменными;

3) Объект исследования стационарный.

Выбор степени полинома возможно:

- с использованием априорной информации об объекте;

- выбор полинома 2-го и 3-го порядка и последовательный отсев незначимых коэффициентов.