Пути нахождения распределения функции

1. Положим, что аргумент X является дискретной случайной величиной.

Если всевозможным значениям аргумента соответствуют все возможные значения функции, то вероятности соответствующих значений X и Y равны между собой.

Если различным возможным значениям X отвечают значения Y, причем среди этих значений Y есть равные между собой, то нуж но складывать вероятности повторяющихся значений Y.

2. Положим, что аргумент X является непрерывной случайной величиной. Нужно определить распределение функции , зная плотность распределения случайного аргумента X. Если y=φ(x) представляет собой дифференцируемую строго возрастающую или строго убывающую функцию, обратная функция которой , то плотность распределения g(y) случайной величины Y находится с помощью равенства

g(y)= f [ψ(y)]ψ/ (y)

Задачи математической статистикb. Генеральная и выборочная совокупности. Повторная и бесповторная выборки. Репрезентативная выборка. Математическая статистика – это наука, занимающаяся методами обработки экспериментальных данных задачи: 1) систематизировать полученный статистический материал; 2) на основании полученных экспериментальных данных оценить интересующие нас числовые характеристики наблюдаемой случайной величины; 3) определить число опытов, достаточное для получения достоверных результатов при минимальных ошибках измерения. Генеральной совокупностьюназывают совокупность всех мысленно возможных объектов данного вида, над которыми проводятся наблюдения с целью получения конкретных значений случайной величины, или совокупность результатов всех мыслимых наблюдений, проводимых в неизменных условиях над одной из случайных величин, связанных с данным видом объектов.Замечание: Часто генеральная совокупность содержит конечное число объектов. Однако если это число достаточно велико, то иногда в целях упрощения вычислений допускают, что генеральная совокупность состоит из бесчисленного множества объектов. Такое допущение оправдывается тем, что увеличение объема генеральной совокупности (достаточно большого объема) практически не сказывается на результатах обработки данных выборки. Выборочной совокупностью называт часть отобранных объектов из генеральной совокупности. Повторной называют выборку, при которой отобранный объект (перед отбором следующего) возвращается в генеральную совокупность. Бесповторнойназывают выборку, при которой отобранный объект в генеральную совокупность не возвращается. На практике обычно пользуются бесповторным случайным отбором. Для того чтобы по данным выборки можно было достаточно уверенно судить об интересующем признаке генеральной совокупности, необходимо, чтобы объекты выборки правильно его представляли. Другими словами, выборка должна правильно представлять пропорции генеральной совокупности. Это требование коротко формулируют так: выборка должна быть репрезентативной (представительной).

и

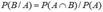

и  В противном случае события являются зависимыми. Условной вероятностью события B при наличии A называется величина

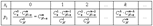

В противном случае события являются зависимыми. Условной вероятностью события B при наличии A называется величина  (при этом полагается, что P(A) не равно 0). Условную вероятностьсобытия P(B/A) можно трактовать как вероятность события B, вычисленная при условии, что событие A произошло.Заметим, что если имеется несколько событий A1, A2, …, An, то их попарная независимость (т.е. независимость любых двух событий Ai и Aj, i≠j) еще не означает их независимости в совокупности. Теорма:Вероятность произвед завиисим событий А и В равна произвед вероятности одного из них на условную вероятность другого, найден а предполож что 1е событие уже наступило P(AB)=P(A)Pa(B) 9.Теорема умножения вероятностей для зависимых и независимых событий Вероятность произведения двух независимый событий равна произведению их вероятностей P(AB)=P(A)P(B) Для 3х независимых событий А,В,С фомула принимает вид P(A1,A2..An)=P(A1)*P(A2)..+P(An) Теорема:Вероятность совместного появления n событийя А1,А2,..An независимых в совокупности, равна произведению вероятностей этих событий P(A1,A2,…An)=P(A1)*P(A2)*..P(An) Теорема1: Вероятность произведения двух зависимых событий А и В равна произведению вероятности одного из них на условную вероятность другого, в предположении, что первое уже произошло, т.е. Р(АВ)= Р(А)РА(В). Теорема2: Вероятность произведения двух независимых событий А и В равна произведению их вероятностей Р(АВ)=Р(А)Р(В). 15.Интегральная теорема Муавра- Лапласа: формулировка теоремы, приближенная формула. Если вероятность p наступления события А в n независимых испытаниях постоянна и отлична от нуля и единицы, то при условии, что число испытаний достаточно велико, вероятность того, что в этих испытаниях событие А наступит от m1 до m2 раз, приближенно равна

(при этом полагается, что P(A) не равно 0). Условную вероятностьсобытия P(B/A) можно трактовать как вероятность события B, вычисленная при условии, что событие A произошло.Заметим, что если имеется несколько событий A1, A2, …, An, то их попарная независимость (т.е. независимость любых двух событий Ai и Aj, i≠j) еще не означает их независимости в совокупности. Теорма:Вероятность произвед завиисим событий А и В равна произвед вероятности одного из них на условную вероятность другого, найден а предполож что 1е событие уже наступило P(AB)=P(A)Pa(B) 9.Теорема умножения вероятностей для зависимых и независимых событий Вероятность произведения двух независимый событий равна произведению их вероятностей P(AB)=P(A)P(B) Для 3х независимых событий А,В,С фомула принимает вид P(A1,A2..An)=P(A1)*P(A2)..+P(An) Теорема:Вероятность совместного появления n событийя А1,А2,..An независимых в совокупности, равна произведению вероятностей этих событий P(A1,A2,…An)=P(A1)*P(A2)*..P(An) Теорема1: Вероятность произведения двух зависимых событий А и В равна произведению вероятности одного из них на условную вероятность другого, в предположении, что первое уже произошло, т.е. Р(АВ)= Р(А)РА(В). Теорема2: Вероятность произведения двух независимых событий А и В равна произведению их вероятностей Р(АВ)=Р(А)Р(В). 15.Интегральная теорема Муавра- Лапласа: формулировка теоремы, приближенная формула. Если вероятность p наступления события А в n независимых испытаниях постоянна и отлична от нуля и единицы, то при условии, что число испытаний достаточно велико, вероятность того, что в этих испытаниях событие А наступит от m1 до m2 раз, приближенно равна  где

где  .Ф(х) – функция Лапласа Значения функции Лапласа Ф(х) берем из соответствующих таблиц, при этом Ф(-х) = - Ф(х). Интегральная теорема Муавра – Лапласа позволяет оценить близость частоты и вероятности. Пусть р – вероятность успеха в схеме Бернулли и k – общее число успехов. Частотой успеха называется отношение

.Ф(х) – функция Лапласа Значения функции Лапласа Ф(х) берем из соответствующих таблиц, при этом Ф(-х) = - Ф(х). Интегральная теорема Муавра – Лапласа позволяет оценить близость частоты и вероятности. Пусть р – вероятность успеха в схеме Бернулли и k – общее число успехов. Частотой успеха называется отношение  . 19. Случайные величины: дискретные и непрерывные. Примеры. Случайной называют величину, которая в результате испытания примет одно и только одно возможное значе ние, наперед не известное и зависящее от случайных причин, которые заранее не могут быть учтены. (чисо очков,выпавших на верхн грани грального кубика) Дискретной (прерывной) называют случайную величину, которая принимает отдельные, изолированные возможные значения с определенными вероятностями. Число возможных значений дискретной случайной величины может быть конечным или бесконечным. Дадим более точное определение : Дискретной случайной величиной (ДСВ) называют такую величину, множество значений которой либо конечное, либо бесконечное, но счетное. (число попаданий в мишень и бросания монеты) Непрерывной случайной величиной (НСВ) называют случайную величину, которая может принимать все значения из некоторого конечного или бесконечного промежутка. Множество возможных значений непрерывной случайной величины бесконечно и несчетно. 20. Закон распределения вероятностей дискретной случайной величины. Заданное соответствие между возможными значениями ДСВХ и их вероятностями называется законом распределения дискретной случайной величины ; его можно задать таблично, аналитически (в виде формулы) и графически. При табличном задании закона распределения дискретной случайной величины первая строка таблицы содержит возможные значения, а вторая - их вероятности: X x1 x2 x3 …xn P p1 p2 p3 …pn Эта таблица называется рядом распределения. Приняв во внимание, что в одном испытании случайная величина принимает одно и только одно возможное значение, заключаем, что события Х=х1, Х=х2, …, Х=хn - образуют полную группу; следовательно, сумма вероятностей этих событий, т. е. сумма вероятностей второй строки таблицы, равна единице:

. 19. Случайные величины: дискретные и непрерывные. Примеры. Случайной называют величину, которая в результате испытания примет одно и только одно возможное значе ние, наперед не известное и зависящее от случайных причин, которые заранее не могут быть учтены. (чисо очков,выпавших на верхн грани грального кубика) Дискретной (прерывной) называют случайную величину, которая принимает отдельные, изолированные возможные значения с определенными вероятностями. Число возможных значений дискретной случайной величины может быть конечным или бесконечным. Дадим более точное определение : Дискретной случайной величиной (ДСВ) называют такую величину, множество значений которой либо конечное, либо бесконечное, но счетное. (число попаданий в мишень и бросания монеты) Непрерывной случайной величиной (НСВ) называют случайную величину, которая может принимать все значения из некоторого конечного или бесконечного промежутка. Множество возможных значений непрерывной случайной величины бесконечно и несчетно. 20. Закон распределения вероятностей дискретной случайной величины. Заданное соответствие между возможными значениями ДСВХ и их вероятностями называется законом распределения дискретной случайной величины ; его можно задать таблично, аналитически (в виде формулы) и графически. При табличном задании закона распределения дискретной случайной величины первая строка таблицы содержит возможные значения, а вторая - их вероятности: X x1 x2 x3 …xn P p1 p2 p3 …pn Эта таблица называется рядом распределения. Приняв во внимание, что в одном испытании случайная величина принимает одно и только одно возможное значение, заключаем, что события Х=х1, Х=х2, …, Х=хn - образуют полную группу; следовательно, сумма вероятностей этих событий, т. е. сумма вероятностей второй строки таблицы, равна единице:  Если множество возможных значений Х бесконечно (счетно), то ряд

Если множество возможных значений Х бесконечно (счетно), то ряд  сходится и его сумма равна единице. З-н распр дискретной случайной величины можно изобразить графически для чего в прямоуг сиситеме координат строят точки M1(x1;p1), M2(x2;з2)…Mn(xn,pn). Полученную фигуру наз многоугольником распр-я 26. Распределение Пуассона. Распределение Пуассона моделирует случайную величину, представляющую собой число событий, произошедших за фиксированное время, при условии, что данные события происходят с некоторой фиксированной средней интенсивностью и независимо друг от друга.Выберем фиксированное число

сходится и его сумма равна единице. З-н распр дискретной случайной величины можно изобразить графически для чего в прямоуг сиситеме координат строят точки M1(x1;p1), M2(x2;з2)…Mn(xn,pn). Полученную фигуру наз многоугольником распр-я 26. Распределение Пуассона. Распределение Пуассона моделирует случайную величину, представляющую собой число событий, произошедших за фиксированное время, при условии, что данные события происходят с некоторой фиксированной средней интенсивностью и независимо друг от друга.Выберем фиксированное число  и определим дискретное распределение, задаваемое следующей функцией вероятности:

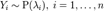

и определим дискретное распределение, задаваемое следующей функцией вероятности:  ,где1k! обозначает факториал,2e=2,7 основаниенатурального логарифма.Тот факт, что случайная величина Y имеет распределение Пуассона с параметром

,где1k! обозначает факториал,2e=2,7 основаниенатурального логарифма.Тот факт, что случайная величина Y имеет распределение Пуассона с параметром  , записывается:

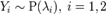

, записывается:  . Свойства: 1Сумма независимых пуассоновских случайных величин также имеет распределение Пуассона. Пусть

. Свойства: 1Сумма независимых пуассоновских случайных величин также имеет распределение Пуассона. Пусть  . Тогда

. Тогда  . 2Пусть

. 2Пусть  , и

, и  . Тогда условное распределение

. Тогда условное распределение  при условии, что

при условии, что  , биномиально. Более точно:

, биномиально. Более точно:  27. Непрерывные случайные величины. Функция распределения ( интегральный закон распределения), ее свойства. Функция распределения содержит всю информация о случайной величине и поэтому изучение случайной величины заключается в исследовании ее функции распределения, которую часто называют просто распределением. Чаще используется термин распределение. Если функция распределения

27. Непрерывные случайные величины. Функция распределения ( интегральный закон распределения), ее свойства. Функция распределения содержит всю информация о случайной величине и поэтому изучение случайной величины заключается в исследовании ее функции распределения, которую часто называют просто распределением. Чаще используется термин распределение. Если функция распределения  непрерывна, то случайная величина

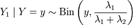

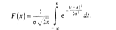

непрерывна, то случайная величина  называется непрерывной случайной величиной. Непрерывная случайная величина Х имеет нормальное распределение (распределена по нормальному закону), если плотность распределения вероятности f(x) имеет вид

называется непрерывной случайной величиной. Непрерывная случайная величина Х имеет нормальное распределение (распределена по нормальному закону), если плотность распределения вероятности f(x) имеет вид  где а и s—некоторые постоянные, называемые параметрами нормального распределения. Функция распределения F(x) в рассматриваемом случае принимает вид

где а и s—некоторые постоянные, называемые параметрами нормального распределения. Функция распределения F(x) в рассматриваемом случае принимает вид  Параметр а- есть математическое ожидание НСВХ, имеющей нормальное распределение, s - среднее квадратическое отклонение, тогда дисперсия равна

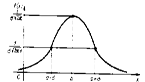

Параметр а- есть математическое ожидание НСВХ, имеющей нормальное распределение, s - среднее квадратическое отклонение, тогда дисперсия равна  34.Интегральная и дифференц функции нормального распределения. Кривая Гаусса. Интегральной функцией распределения F(x) называютфункцию, каждое значение которой для каждого х является вероятностью события, заключающегося в том, что случайная величина xi в i -м опыте принимает значение, меньшее х. Свойства: ? неотрицательная, т.е. F(x) ? 0; ? неубывающая, т.е. f (x2) ? F(x1), если x2 ? x1; ? диапазон ее изменения: от 0 до 1, т.е. F(??) = 0; F(+?) = 1; ? вероятность нахождения случайной величины х в диапазоне от x1 до x2: P{x1 < x < x2}= F(x2) ? F(x1). При бесконечном увеличении числа наблюдений n> ? и бесконечном уменьшении ширины интервалов Дl >0, ступенчатая кривая, огибающая гистограмму, перейдет в плавную кривую f (x) (рис. 2), называемую кривой плотности распределения вероятностей случайной величины, а уравнение, описывающее ее, - дифференциальным законом распределения. кривая Гаусса Симметричная параболическая кривая, иногда возникающая при изображении серии результатов на частотном графике. Многие переменные образуют нормальное распределение, когда измерения проводятся в целой популяции. Считается, что рост человека и коэффициент умственного развития подчиняются принципу нормального распределения при достаточно большом количестве участников. На кривой Гаусса большинст результатов концентрируется вокруг центра, а наиболее высокие и низкие результаты встречаются гораздо реже. Эти «хвосты» нормального распределения вытягиваются в обоих направлениях вдоль оси абсцисс и теоретически никог не соприкасаются с нею

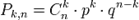

34.Интегральная и дифференц функции нормального распределения. Кривая Гаусса. Интегральной функцией распределения F(x) называютфункцию, каждое значение которой для каждого х является вероятностью события, заключающегося в том, что случайная величина xi в i -м опыте принимает значение, меньшее х. Свойства: ? неотрицательная, т.е. F(x) ? 0; ? неубывающая, т.е. f (x2) ? F(x1), если x2 ? x1; ? диапазон ее изменения: от 0 до 1, т.е. F(??) = 0; F(+?) = 1; ? вероятность нахождения случайной величины х в диапазоне от x1 до x2: P{x1 < x < x2}= F(x2) ? F(x1). При бесконечном увеличении числа наблюдений n> ? и бесконечном уменьшении ширины интервалов Дl >0, ступенчатая кривая, огибающая гистограмму, перейдет в плавную кривую f (x) (рис. 2), называемую кривой плотности распределения вероятностей случайной величины, а уравнение, описывающее ее, - дифференциальным законом распределения. кривая Гаусса Симметричная параболическая кривая, иногда возникающая при изображении серии результатов на частотном графике. Многие переменные образуют нормальное распределение, когда измерения проводятся в целой популяции. Считается, что рост человека и коэффициент умственного развития подчиняются принципу нормального распределения при достаточно большом количестве участников. На кривой Гаусса большинст результатов концентрируется вокруг центра, а наиболее высокие и низкие результаты встречаются гораздо реже. Эти «хвосты» нормального распределения вытягиваются в обоих направлениях вдоль оси абсцисс и теоретически никог не соприкасаются с нею  4.Действия над событиями. Классическ, геометрическ и статистическое опр вероят Cуммой событий А и Вназ событие А+В состоящие в наступлении хотя бы одного из них. Суммой нескольких событий наз событие, кот состоит в появлении хоотя бы одного их этих событий. Произвед событи А и В наз Событие С=А*В состоящ в совместном нвступл событий Произвед нескольк событи назсобытие состоящ в совсместн поял всех событий Разностью событий А и В назсобытие С=А-В происх тогда и только тогд, когда происход событие А но не В События и их действия можно наглдно иллюстр с помощью диаграмм Элера-Венна.Достоверн событие изображ прямоуг, элемментар случ события-точками прямоугол, случ события-внутри их. Св-ва диграмм: 1.A+B=B+A; A*B=B*A 2.(A+B)*C=A*C+B*C 3.(A+B)+C=A+(B+C) 4.A*B)*C=A*(B*C) 5.A+A=A;A*A=A Классич опр вероятнпредпол что все элементр исходы равновозможны. Геометрич вероятн. Пусть отрезокlявл частью отрезка L. Если на отрезк L наудачу ставится точка, то вероятн попад этой точки на отрезок l опр равенство P(A)=длина l/длина L Статистич вероятностью события A наз отнош числа испытан в кот появил соытие А к общему числу произв испытаний W(A)+m/n. Статистич вероятн всегда вычисляется на основании результатоы испытаний 11. Произведение двух и более событий. Произведением нескольких событий называется событие, состоящее в их совместном наступлении в результате испытания.Обозначение произведения событий : АВ Произведением АВ событий А и В называется событие, состоящее в том, что произошло и событие А, и событие В. Аналогично произведением нескольких событий называется событие, заключающееся в том, что произошли все эти события. Для 3х независимых событий А,В,С фомула принимает вид P(A1,A2..An)=P(A1)*P(A2)..+P(An) 13. Повторные независимые испытания: постановка задачи, схема Бернулли, формула Бернулли. Повторные независимые испытания-многократные испытания, в кот. вероятность появл событий А в каждом испытании не меняется в зависимости от исзодов др испытаний. Впервые схема независ испытан рассмотрена Бернулли для к=2. Под схемой Бернулли понимают проведение в n испытаний, в кажлом из которых возможны два исхода: либо наступ событие А, либо не наступает.те противополож ему и при этом: 1. все n испытания независимы2.вероятность событ А в каждом отдельном испытании постоянна и не меняется от испыт к испытан. Формула Бернулли Вслучае небольшого числа испытаний n вероятность Pk,n того, что в k независ испытаниях событие А наступит ровно n раз, опр-ся в соответсвии сформулой Бернулли

4.Действия над событиями. Классическ, геометрическ и статистическое опр вероят Cуммой событий А и Вназ событие А+В состоящие в наступлении хотя бы одного из них. Суммой нескольких событий наз событие, кот состоит в появлении хоотя бы одного их этих событий. Произвед событи А и В наз Событие С=А*В состоящ в совместном нвступл событий Произвед нескольк событи назсобытие состоящ в совсместн поял всех событий Разностью событий А и В назсобытие С=А-В происх тогда и только тогд, когда происход событие А но не В События и их действия можно наглдно иллюстр с помощью диаграмм Элера-Венна.Достоверн событие изображ прямоуг, элемментар случ события-точками прямоугол, случ события-внутри их. Св-ва диграмм: 1.A+B=B+A; A*B=B*A 2.(A+B)*C=A*C+B*C 3.(A+B)+C=A+(B+C) 4.A*B)*C=A*(B*C) 5.A+A=A;A*A=A Классич опр вероятнпредпол что все элементр исходы равновозможны. Геометрич вероятн. Пусть отрезокlявл частью отрезка L. Если на отрезк L наудачу ставится точка, то вероятн попад этой точки на отрезок l опр равенство P(A)=длина l/длина L Статистич вероятностью события A наз отнош числа испытан в кот появил соытие А к общему числу произв испытаний W(A)+m/n. Статистич вероятн всегда вычисляется на основании результатоы испытаний 11. Произведение двух и более событий. Произведением нескольких событий называется событие, состоящее в их совместном наступлении в результате испытания.Обозначение произведения событий : АВ Произведением АВ событий А и В называется событие, состоящее в том, что произошло и событие А, и событие В. Аналогично произведением нескольких событий называется событие, заключающееся в том, что произошли все эти события. Для 3х независимых событий А,В,С фомула принимает вид P(A1,A2..An)=P(A1)*P(A2)..+P(An) 13. Повторные независимые испытания: постановка задачи, схема Бернулли, формула Бернулли. Повторные независимые испытания-многократные испытания, в кот. вероятность появл событий А в каждом испытании не меняется в зависимости от исзодов др испытаний. Впервые схема независ испытан рассмотрена Бернулли для к=2. Под схемой Бернулли понимают проведение в n испытаний, в кажлом из которых возможны два исхода: либо наступ событие А, либо не наступает.те противополож ему и при этом: 1. все n испытания независимы2.вероятность событ А в каждом отдельном испытании постоянна и не меняется от испыт к испытан. Формула Бернулли Вслучае небольшого числа испытаний n вероятность Pk,n того, что в k независ испытаниях событие А наступит ровно n раз, опр-ся в соответсвии сформулой Бернулли  , где

, где  . .21.Математическое ожидание дискретной случайной величины, его свойства. Математическое ожидание ДСВХ равно сумме произведений всех ее возможных значений на их вероятности, т.е.

. .21.Математическое ожидание дискретной случайной величины, его свойства. Математическое ожидание ДСВХ равно сумме произведений всех ее возможных значений на их вероятности, т.е.  Если ДСВХ принимает счетное множество значений, то

Если ДСВХ принимает счетное множество значений, то  Свойства математического ожидания 1. М(С) =С, где С=const; 2. М(СХ)= СМ(Х); 3. М(XY) =M(X)M(Y), где Х и У- независимые случайные величины; 4. М(Х+У) = М(Х) +М(У), где Х и У- независимые случайные величины. Заметим, что математическое ожидание для данной ДСВХ есть величина постоянная 22.Дисперсия дискретной случайной величины, ее свойства. Дисперсией ДСВХ (D(X)) называют математическое ожидание квадрата отклонения СВ от ее математического ожидания, т.е.

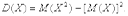

Свойства математического ожидания 1. М(С) =С, где С=const; 2. М(СХ)= СМ(Х); 3. М(XY) =M(X)M(Y), где Х и У- независимые случайные величины; 4. М(Х+У) = М(Х) +М(У), где Х и У- независимые случайные величины. Заметим, что математическое ожидание для данной ДСВХ есть величина постоянная 22.Дисперсия дискретной случайной величины, ее свойства. Дисперсией ДСВХ (D(X)) называют математическое ожидание квадрата отклонения СВ от ее математического ожидания, т.е.  Для вычисления D(X) удобнее пользоваться следующей формулой, которая выводится на основании свойств математического ожидания:

Для вычисления D(X) удобнее пользоваться следующей формулой, которая выводится на основании свойств математического ожидания:  Свойства дисперсии 1. D(C) =0 , где С = const; 2. D(CX) = C2D(X); 3. D(X+Y)=D(X)+D(Y) 4. D(X-Y)=D(X)+D(Y) 30. Математическое ожидание непрерывной случайной величины Математическое ожидание непрерывной случайной величины вычисляется по формуле:

Свойства дисперсии 1. D(C) =0 , где С = const; 2. D(CX) = C2D(X); 3. D(X+Y)=D(X)+D(Y) 4. D(X-Y)=D(X)+D(Y) 30. Математическое ожидание непрерывной случайной величины Математическое ожидание непрерывной случайной величины вычисляется по формуле:  В частности, если с.в. задана своей плотностью вероятности на каком-либо отрезке, то и интеграл вычисляем на этом отрезке Математическое ожиданием – это средняя величина возможных значений случайных величин, взвешенных по их вероятности. 23. Биномиальное распределение дискретной случайной величины и его числовые характеристики Биномиальным называют закон распределения дискретной случайной величины X - числа появлений события в n независимых испытаниях, в каждом из которых вероятность наступления события постоянна. Вероятности pi вычисляют по формуле Бернулли

В частности, если с.в. задана своей плотностью вероятности на каком-либо отрезке, то и интеграл вычисляем на этом отрезке Математическое ожиданием – это средняя величина возможных значений случайных величин, взвешенных по их вероятности. 23. Биномиальное распределение дискретной случайной величины и его числовые характеристики Биномиальным называют закон распределения дискретной случайной величины X - числа появлений события в n независимых испытаниях, в каждом из которых вероятность наступления события постоянна. Вероятности pi вычисляют по формуле Бернулли  Для биномиального распределения: математическое ожидание M(X) = np, дисперсия D(X) = npq, мода np-q ≤ Mo ≤ np+p, коэффициент асимметрии As = (q - p)/√npq, коэффициент эксцесса Ex = (1 - 6pq)/npq В пределе при n→∞ биномиальное распределение по своим значениям приближается к нормальному с параметрами a=np и σ=√npq В пределе при n→∞ и при p→0 биномиальное распределение превращается в распределение Пуассона с параметром λ=np 24.Геометрическое распределение и его числовые характеристики. Гипергеометрическое распределение Производится серия испытаний. Случайная величина - количество испытаний до появления первого успеха (например, бросание мяча в корзину до первого попадания). Закон распределения имеет вид:

Для биномиального распределения: математическое ожидание M(X) = np, дисперсия D(X) = npq, мода np-q ≤ Mo ≤ np+p, коэффициент асимметрии As = (q - p)/√npq, коэффициент эксцесса Ex = (1 - 6pq)/npq В пределе при n→∞ биномиальное распределение по своим значениям приближается к нормальному с параметрами a=np и σ=√npq В пределе при n→∞ и при p→0 биномиальное распределение превращается в распределение Пуассона с параметром λ=np 24.Геометрическое распределение и его числовые характеристики. Гипергеометрическое распределение Производится серия испытаний. Случайная величина - количество испытаний до появления первого успеха (например, бросание мяча в корзину до первого попадания). Закон распределения имеет вид:  Если количество испытаний не ограничено, т.е. если случайная величинв может принимать значения 1, 2, ..., ∞, то математическое ожидание и дисперсию геометрического распределения можно найти по формулам M(X) = 1/p, D(X) = q/p2 Гипергеометрическое рапределение Имеется N объектов. Из них n объектов обладают требуемым свойством. Из общего количества отбирается m объектов. Случайная величина X - число объектов из m отобранных, обладающих требуемым свойством. Для вычисления вероятностей используются биномиальные коэффициенты (см. число сочетаний). Закон распределения имеет вид:

Если количество испытаний не ограничено, т.е. если случайная величинв может принимать значения 1, 2, ..., ∞, то математическое ожидание и дисперсию геометрического распределения можно найти по формулам M(X) = 1/p, D(X) = q/p2 Гипергеометрическое рапределение Имеется N объектов. Из них n объектов обладают требуемым свойством. Из общего количества отбирается m объектов. Случайная величина X - число объектов из m отобранных, обладающих требуемым свойством. Для вычисления вероятностей используются биномиальные коэффициенты (см. число сочетаний). Закон распределения имеет вид:  25.Равномерное распредел непрерывной случайной величины. Показательное распределение. Распределение вероятностей непрерывной случайной величины Х, принимающей значения на отрезке [a,b] наз-ся равномерным.Если ее плотность вероятность на этом отрезке постоянна, а вне его равна 0, т.е {0, x<a) f(x)={c, a<=x<=b} {0, x>b} Показательное распределение.Непрерывная случайная величина Х имеет показательное распределение, если плотность распределения ее вероятностей выражается формулой:число.

25.Равномерное распредел непрерывной случайной величины. Показательное распределение. Распределение вероятностей непрерывной случайной величины Х, принимающей значения на отрезке [a,b] наз-ся равномерным.Если ее плотность вероятность на этом отрезке постоянна, а вне его равна 0, т.е {0, x<a) f(x)={c, a<=x<=b} {0, x>b} Показательное распределение.Непрерывная случайная величина Х имеет показательное распределение, если плотность распределения ее вероятностей выражается формулой:число.  Равномерное распределение. Непрерывная величина Х распределена равномерно на интервале (a, b), если все ее возможные значения находятся на этом интервале и плотность распределения вероятностей постоянна:

Равномерное распределение. Непрерывная величина Х распределена равномерно на интервале (a, b), если все ее возможные значения находятся на этом интервале и плотность распределения вероятностей постоянна:

Для случайной величины Х , равномерно распределенной в интервале (a, b) (рис. 4), вероятность попадания в любой интервал (x1, x2), лежащий внутри интервала (a, b), равна:

Для случайной величины Х , равномерно распределенной в интервале (a, b) (рис. 4), вероятность попадания в любой интервал (x1, x2), лежащий внутри интервала (a, b), равна:  33. Вероятность попадания нормального распределенной случайной величины в заданный интервал. Вероятность заданного отклонения. Правило трех сигм. Вероятность попадания случайной величины в заданный интервал Может быть вычислена двумя способами: 1) через функцию распределения P (α < X < β ) = F ( β ) − F (α ) 2) через плотность распределения P (α < X < β ) = ∫ f ( x ) dx α β 16 Правило «трех сигма». Если случайная величина распределена нормально, то абсолютная величина ее отклонения от мат ожидания не превосходит утроенного среднего квадратического отклонения. Запишем вероятность того, что отклонение нормально распределенной случайной величины от математического ожидания меньше заданной величины D:

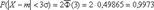

33. Вероятность попадания нормального распределенной случайной величины в заданный интервал. Вероятность заданного отклонения. Правило трех сигм. Вероятность попадания случайной величины в заданный интервал Может быть вычислена двумя способами: 1) через функцию распределения P (α < X < β ) = F ( β ) − F (α ) 2) через плотность распределения P (α < X < β ) = ∫ f ( x ) dx α β 16 Правило «трех сигма». Если случайная величина распределена нормально, то абсолютная величина ее отклонения от мат ожидания не превосходит утроенного среднего квадратического отклонения. Запишем вероятность того, что отклонение нормально распределенной случайной величины от математического ожидания меньше заданной величины D:  Если принять D = 3s, то получаем с использованием таблиц значений функции Лапласа:

Если принять D = 3s, то получаем с использованием таблиц значений функции Лапласа:  Т.е. вероятность того, что случайная величина отклонится от своего математического ожидание на величину, большую чем утроенное среднее квадратичное отклонение, практически равна нулю. Это правило называется правилом трех сигм. 38. Математическое ожидание и дисперсия функции одного случайного аргумента для двух случаев: aргумент – дискретная случайная величина. Функция случайного аргумента X задана законом Y =φ(X )Пусть аргумент Х является дискретной случайной величи ной с возможными значениями x1, х2, ..., хn, вероятности которых соответственно равны pl, p2, ..., рn. Ясно, что Y также является дискретной случайной величиной с воз можными значениями y1 = φ(x1), y2 = φ(x2), ... , yn = φ(xn). Известно, что событие «величина X приняла значение xi означает, что событие «величина Y приняла значение φ(xi). В связи с этим можно гово рить, что вероятности возможных значений Y соответственно равны pl, p2, ..., рn. Таким образом, математическое ожидание функции равно:

Т.е. вероятность того, что случайная величина отклонится от своего математического ожидание на величину, большую чем утроенное среднее квадратичное отклонение, практически равна нулю. Это правило называется правилом трех сигм. 38. Математическое ожидание и дисперсия функции одного случайного аргумента для двух случаев: aргумент – дискретная случайная величина. Функция случайного аргумента X задана законом Y =φ(X )Пусть аргумент Х является дискретной случайной величи ной с возможными значениями x1, х2, ..., хn, вероятности которых соответственно равны pl, p2, ..., рn. Ясно, что Y также является дискретной случайной величиной с воз можными значениями y1 = φ(x1), y2 = φ(x2), ... , yn = φ(xn). Известно, что событие «величина X приняла значение xi означает, что событие «величина Y приняла значение φ(xi). В связи с этим можно гово рить, что вероятности возможных значений Y соответственно равны pl, p2, ..., рn. Таким образом, математическое ожидание функции равно:  39. Математическое ожидание и дисперсия функции одного случайного аргумента для двух случаев: a) аргумент – непрерывная случайная величина Функция случайного аргумента X задана законом Y =φ(X ) Допустим, аргумент X является непрерывной случайной ве личиной, которая задана плотностью распределения f(x). Чтобы найти математическое ожидание функции Y = φ( X ), для начала можно отыскать плотность распределения g(y) величины Y, а потом применить формулу:

39. Математическое ожидание и дисперсия функции одного случайного аргумента для двух случаев: a) аргумент – непрерывная случайная величина Функция случайного аргумента X задана законом Y =φ(X ) Допустим, аргумент X является непрерывной случайной ве личиной, которая задана плотностью распределения f(x). Чтобы найти математическое ожидание функции Y = φ( X ), для начала можно отыскать плотность распределения g(y) величины Y, а потом применить формулу:  В том случае, если отыскать функцию g(y) затруднительно, можно непосредственно вычислить математическое ожидание функции по формуле:

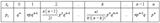

В том случае, если отыскать функцию g(y) затруднительно, можно непосредственно вычислить математическое ожидание функции по формуле:  41. Статистическое распределение выборки. Эмпирическая функция распределения. Полигон и гистограмма. Статистическим (эмпирическим) законом распределения выборки, или просто статистическим распределением выборки называют последовательность вариант хi и соответствующих им частот ni или относительных частот wi. Статистическое распред выборки удобно представлять в форме таблицы распред частот, наз статистическим дискретным рядом распред-я: X1 x2 … xm N1 n2 … nm Эмпирической функцией распределения,построенной по выборке

41. Статистическое распределение выборки. Эмпирическая функция распределения. Полигон и гистограмма. Статистическим (эмпирическим) законом распределения выборки, или просто статистическим распределением выборки называют последовательность вариант хi и соответствующих им частот ni или относительных частот wi. Статистическое распред выборки удобно представлять в форме таблицы распред частот, наз статистическим дискретным рядом распред-я: X1 x2 … xm N1 n2 … nm Эмпирической функцией распределения,построенной по выборке  объема n, называется случайная функция

объема n, называется случайная функция  , при каждом

, при каждом  равная

равная  Полигоном частот называют ломанную, отрезки которой соединяют точки (x1; n1), (x2; n2), ..., (xk; nk). Для построения полигона частот на оси абсцисс откладывают варианты xi, а на оси ординат - соответствующие им частоты ni. Точки ( xi; ni) соединяют отрезками прямых и получают полигон частот Гистограммой частот называют ступенчатую фигуру, состоящую из прямоугольников, основаниями которых служат частичные интервалы длиной h, а высоты равны отношению ni / h (плотность частоты). Для построения гистограммы частот на оси абсцисс откладывают частичные интервалы, а над ними проводят отрезки, параллельные оси абсцисс на расстоянии ni / h.Площадь i - го частичного прямоугольника равна hni / h = ni - сумме частот вариант i - го интервала; следовательно, площадь гистограммы частот равна сумме всех частот, т.е. объему выборки. 47.Постановка типовых задач проверки гипотезПостановка задачи начинается с выдвижения основного утверждения (нулевой гипотезы Н0), причем наряду с выдвинутой гипотезой всегда рассматривают и противоречащую ей гипотезу, которую называют конкурирующей (альтернативной) гипотезой Н1. Далее на основе экспериментальной информации конструируется специально подобранная из разумных соображений случайная величина, распределение которой известно при выполнении гипотезы Н0. Именно эта случайная величина К,которую называют статистическим критерием или просто критерием служит для проверки справедливости нулевой гипотезы Н0.После выбора определенного критерия К множество всех его возможных значений разбивают на два непересекающихся подмножества: одно из них содержит значения критерия, при которых нулевая гипотеза принимается, а другое, при которых она отвергается. 50.Виды зависимостей. Понятие линейной регрессии и корреляции. Линейная корреляция.Корреляционная зависимость между случайными величинами Х и У называетсялинейной корреляцией, если обе функции регрессии f(y) и g(x) являются линейными. В этом случае линии регрессии- прямые и называются прямыми регрессии.Уравнение прямой регрессии У на Х имеет вид :

Полигоном частот называют ломанную, отрезки которой соединяют точки (x1; n1), (x2; n2), ..., (xk; nk). Для построения полигона частот на оси абсцисс откладывают варианты xi, а на оси ординат - соответствующие им частоты ni. Точки ( xi; ni) соединяют отрезками прямых и получают полигон частот Гистограммой частот называют ступенчатую фигуру, состоящую из прямоугольников, основаниями которых служат частичные интервалы длиной h, а высоты равны отношению ni / h (плотность частоты). Для построения гистограммы частот на оси абсцисс откладывают частичные интервалы, а над ними проводят отрезки, параллельные оси абсцисс на расстоянии ni / h.Площадь i - го частичного прямоугольника равна hni / h = ni - сумме частот вариант i - го интервала; следовательно, площадь гистограммы частот равна сумме всех частот, т.е. объему выборки. 47.Постановка типовых задач проверки гипотезПостановка задачи начинается с выдвижения основного утверждения (нулевой гипотезы Н0), причем наряду с выдвинутой гипотезой всегда рассматривают и противоречащую ей гипотезу, которую называют конкурирующей (альтернативной) гипотезой Н1. Далее на основе экспериментальной информации конструируется специально подобранная из разумных соображений случайная величина, распределение которой известно при выполнении гипотезы Н0. Именно эта случайная величина К,которую называют статистическим критерием или просто критерием служит для проверки справедливости нулевой гипотезы Н0.После выбора определенного критерия К множество всех его возможных значений разбивают на два непересекающихся подмножества: одно из них содержит значения критерия, при которых нулевая гипотеза принимается, а другое, при которых она отвергается. 50.Виды зависимостей. Понятие линейной регрессии и корреляции. Линейная корреляция.Корреляционная зависимость между случайными величинами Х и У называетсялинейной корреляцией, если обе функции регрессии f(y) и g(x) являются линейными. В этом случае линии регрессии- прямые и называются прямыми регрессии.Уравнение прямой регрессии У на Х имеет вид :

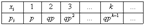

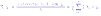

График корреляционной зависимости строится по уравнениям функции  и и  , которые называютсярегрессией , которые называютсярегрессией |

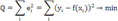

51. Метод наименьших квадратов для отыскания параметров выборочного уравнения прямой линии регрессии с группированным данным Метод наименьших квадратов (МНК) - метод оценивания параметров линейной регрессии, минимизирующий сумму квадратов отклонений наблюдений зависимой переменной от искомой линейной функции.  где уi- статические значения зависимой переменной; f (х) - теоретические значения зависимой переменной, рассчитанные с помощью уравнения регрессии.

где уi- статические значения зависимой переменной; f (х) - теоретические значения зависимой переменной, рассчитанные с помощью уравнения регрессии.

52.Выборочный коэффициент корреляции и его свойства. Выборочный коэффициент корреляциинаходится по формуле  где

где  - выборочные средние квадратические отклонения величин X и Y.Выборочный коэффициент корреляции

- выборочные средние квадратические отклонения величин X и Y.Выборочный коэффициент корреляции  показывает тесноту линейной связи между X и Y: чем ближе

показывает тесноту линейной связи между X и Y: чем ближе  к единице, тем сильнее линейная связь между X и Y.

к единице, тем сильнее линейная связь между X и Y.