Обучение обучаемых нейронных сетей

Различают наблюдаемое обучение нейронных сетей, ненаблюдаемое обучение и смешанное обучение:

· наблюдаемое обучение нейронных сетей имеет место в том случае, когда известны правильные выходы нейронной сети;

· при ненаблюдаемом обучении нейронных сетей добиваются того, чтобы «близкие» входные векторы формировали «близкие» выходы нейронной сети. Ненаблюдаемое обучение используется, например, при решении задачи кластеризации;

· при смешанном обучении нейронных сетей часть параметров определяется при наблюдаемом обучении, а часть – при ненаблюдаемом обучении.

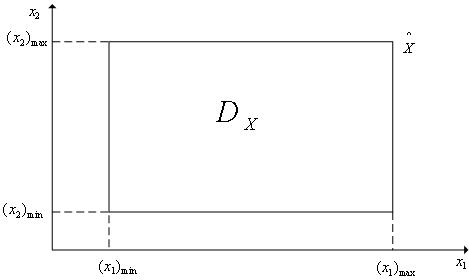

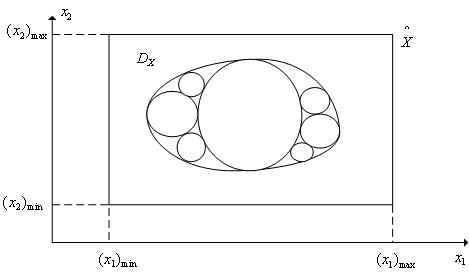

Введем в рассмотрение пространство входов нейронной сети  . Оси координат этого пространства соответствуют входам нейронной сети

. Оси координат этого пространства соответствуют входам нейронной сети  . В пространстве

. В пространстве  определим множество допустимых входов нейронной сети

определим множество допустимых входов нейронной сети  (см. рис. 8).

(см. рис. 8).

|

Рис. 8. Пространство входов нейронной сети X и множество допустимых входов нейронной сетиDX.n=2.

В задачах, которые эффективно решаются нейронными сетями, точки множества  образуют связные области, все точки каждой из которых обладают одним и тем же свойством, например, принадлежат одному и тому же кластеру.

образуют связные области, все точки каждой из которых обладают одним и тем же свойством, например, принадлежат одному и тому же кластеру.

Задача конструирования или обучения нейронной сети в этих терминах состоит в том, чтобы при принадлежности входного вектора нейронной сети  разным областям формировались различные выходные сигналы нейронной сети. Можно сказать, что в результате обучения нейронной сети она запоминает расположение этих областей во множестве

разным областям формировались различные выходные сигналы нейронной сети. Можно сказать, что в результате обучения нейронной сети она запоминает расположение этих областей во множестве  .

.

Запоминание расположения областей по разному реализуется в персептронных нейронных сетях и в нейронных сетях с радиальными базисными функциями.

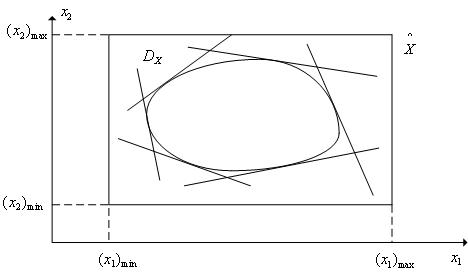

В персептронных нейронных сетях запоминание областей реализуется с помощью гиперплоскостей (см. рис. 9). Каждый нейрон такой сети весами своих входов задает гиперплоскость

Изменение весов входов, числа нейронов и графа межнейронных связей меняет набор и расположение разделяющих гиперплоскостей.

В нейронных сетях с радиальными базисными функциям каждый нейрон задет значениями весов своих входов координаты центра гипершара, а коэффициентом, связывающим  и

и  – радиус этого гипершара (см. рис. 10).

– радиус этого гипершара (см. рис. 10).

|

Рис. 9. К запоминанию областей в персептронных нейронных сетях.N=2.

|

Рис. 10. К запоминанию областей в нейронных сетях с радиальными базисными функциям. N=2.

Большинство алгоритмов обучения нейронных сетей используют эвристические алгоритмы формирования графов межнейронных сетей и весов входов нейронов.

Обучение персептронной нейронной сети производится по следующей схеме.

1. Выбор начальной межнейронной сети. Число входов и выходов сети определяется постановкой задачи. Граф межнейронных связей обычно выбирается эвристически. Например, по одной из эвристик в качестве начальной рекомендуется взять трех-слойную нейронную сеть с числом нейронов внутреннего слоя, равным полусумме числа входов и выходов нейронной сети. При этом каждый нейрон внутреннего слоя должен быть связан с выходами всех входных нейронов сети, а каждый выходной нейрон должен быть связан с выходами всех нейронов внутреннего слоя.

2. Подбор весов входов нейронов так, чтобы нейронная сеть решала поставленную задачу. Известным алгоритмом определения весов нейронов для персептронных нейронных сетей является алгоритм обратного распространения (см. ниже), для которого доказана его сходимость. Широко используются для подбора весов нейронов различные алгоритмы случайного поиска, например, генетические алгоритмы.

3. Изменение графа межнейронных связей (если подбор весов не удался) и переход к п. 2. Для этого используют различные эвристики, например, эвристики на основе генетических алгоритмов.