Метод наименьших квадратов. Постановка задачи

Постановка задачи. Объект имеет m входных

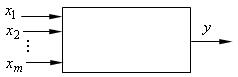

Постановка задачи. Объект имеет m входных  и одну выходную координату у. Структурная схема такого объекта приведена на рис. 8.1.

и одну выходную координату у. Структурная схема такого объекта приведена на рис. 8.1.

Не будем делать различия между регулируемыми и нерегулируемыми переменными. Обозначим

Не будем делать различия между регулируемыми и нерегулируемыми переменными. Обозначим  вектор входных координат, Т знак транспонирования. Проведено n экспериментов, в каждом из которых, при известных значениях входных координат

вектор входных координат, Т знак транспонирования. Проведено n экспериментов, в каждом из которых, при известных значениях входных координат  определялись соответствующие им в установившемся режиме значения

определялись соответствующие им в установившемся режиме значения  , выходной координаты (j – номер эксперимента). Требуется построить математическую модель объекта.

, выходной координаты (j – номер эксперимента). Требуется построить математическую модель объекта.

Уточним, что в данном случае может служить моделью объекта. Поскольку на выходную координату объекта, помимо учитываемых входных координат, всегда влияют и неучитываемые переменные, которые рассматриваются как некоторые случайные величины помехи, то определяемые экспериментально значения выходной координаты тоже случайны. В связи с этим выходная координата у зависит от входных не функционально, а стохастически, вероятностно. В этом случае связь, существующая между переменными х и у, называется корреляционной связью.

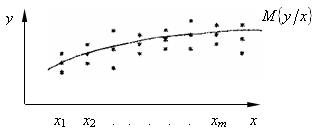

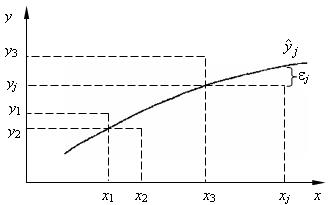

Зависимость математического ожидания выходной координаты у от х называется регрессионной зависимостью. Она и может в данном случае служить математической моделью объекта. Кривая, описывающая зависимость

Зависимость математического ожидания выходной координаты у от х называется регрессионной зависимостью. Она и может в данном случае служить математической моделью объекта. Кривая, описывающая зависимость  от х, называется кривой регрессии. Пример кривой регрессии приведен на рис. 8.2.

от х, называется кривой регрессии. Пример кривой регрессии приведен на рис. 8.2.

При построении модели в нашем распоряжении имеется совокупность экспериментально полученных значений входных и выходной координаты. Ей соответствует совокупность точек в пространстве

При построении модели в нашем распоряжении имеется совокупность экспериментально полученных значений входных и выходной координаты. Ей соответствует совокупность точек в пространстве  , если объект имеет одну входную координату х (рис. 8.3).

, если объект имеет одну входную координату х (рис. 8.3).

Ясно, что кривая регрессии должна проходить вблизи экспериментальных точек. Точнее, значения выходной переменной

Ясно, что кривая регрессии должна проходить вблизи экспериментальных точек. Точнее, значения выходной переменной  , находимой по модели при условии, что входные координаты приняли значение

, находимой по модели при условии, что входные координаты приняли значение  (j – номер эксперимента), должны быть близки к значениям выходной координаты

(j – номер эксперимента), должны быть близки к значениям выходной координаты  , определенным экспериментально при тех же значениях входных переменных. Это условие и используется при построении модели. Для этого сформируем функцию F, оценивающую невязку e – степень отклонения

, определенным экспериментально при тех же значениях входных переменных. Это условие и используется при построении модели. Для этого сформируем функцию F, оценивающую невязку e – степень отклонения  от

от  ,

,  . Эти отклонения указаны на рис. 8.3 применительно к случаю, когда объект имеет одну входную координату. В методе наименьших квадратов, используется квадрат невязки:

. Эти отклонения указаны на рис. 8.3 применительно к случаю, когда объект имеет одну входную координату. В методе наименьших квадратов, используется квадрат невязки:

.

.

Вид зависимости  задается. В общем виде зависимость можно представить в виде:

задается. В общем виде зависимость можно представить в виде:

, , | (8.1) |

где  – вектор параметров модели (коэффициенты).

– вектор параметров модели (коэффициенты).

Задача состоит в том, чтобы по опытным данным наилучшим образом определить значения параметров  .

.

В этом случае метод наименьших квадратов сводится к следующему. Наилучшими будут те значения параметров  , при которых сумма квадратов отклонений отклонений расчетных величин

, при которых сумма квадратов отклонений отклонений расчетных величин  от опытных

от опытных  окажется наименьшей.

окажется наименьшей.

Учитывая, что при нахождении параметров количество экспериментов n постоянно, степень близости модели и объекта будет оцениваться величиной:

| (8.2) |

Таким образом, в методе наименьших квадратов параметры находятся из условия:

,

,

т.е. являются решением задачи минимизации суммы квадратов невязки (этим и объясняется название метода).

Покажем, как решается эта задача.

Пусть функция задана в общем виде (I). Структуру модели, входящие в нее входные координаты или функции от них, можно затем уточнить. Запишем условия всех опытов в виде таблицы матрицы плана эксперимента:

| (8.3) |

Здесь каждая строка – условие одного опыта; каждый столбец значения одной переменной – в разных опытах.

Рассмотрим также вектор-столбец результатов эксперимента

| (8.4) |

Расчетное значение  для j-той строки матрицы

для j-той строки матрицы  будет иметь вид:

будет иметь вид:

| (8.5) |

Приведенное выше определение метода наименьших квадратов может быть записано формулой:

| (8.6) |

Те значения  , при которых сумма S окажется минимальной и будут наилучшими.

, при которых сумма S окажется минимальной и будут наилучшими.

Проще всего расчет методом наименьших квадратов, осуществляется, когда уравнение (8.1) линейно относительно коэффициентов  . Это значит, что его можно записать в следующем виде:

. Это значит, что его можно записать в следующем виде:

| (8.7) |

Здесь  фиктивная переменная, тождественно равная единице. Она вводится для симметрии для того, чтобы все параметры, и в том числе

фиктивная переменная, тождественно равная единице. Она вводится для симметрии для того, чтобы все параметры, и в том числе  , входили в модель единообразно. Это упрощает выкладки.

, входили в модель единообразно. Это упрощает выкладки.

Рассмотрим расчет коэффициентов для этого случая. Матрица  будет иметь вид:

будет иметь вид:

| (8.8) |

Квадрат разности для 3-го опыта запишется так:

| (8.9) |

Подставляя зависимость (8.9) в выражение (8.6), получим:

| (8.10) |

Необходимым условием минимума функции  является равенство нулю ее частных производных по искомым параметрам (поскольку функция

является равенство нулю ее частных производных по искомым параметрам (поскольку функция  является квадратичной, то эти условия выделяют единственную точку минимума).

является квадратичной, то эти условия выделяют единственную точку минимума).

,

,  , …,

, …,

или

Запишем эту систему в виде, удобном для анализа

| (8.11) |

Полученная система линейных алгебраических уравнений содержит столько уравнений, сколько в нее входит неизвестных параметров Б. В теории метода систему (8.11) принято называть системой нормальных уравнений.

Система нормальных уравнений может быть решена, например, по правилу Крамера, согласно которому  , где

, где  – определитель матрицы системы нормальных уравнений:

– определитель матрицы системы нормальных уравнений:

,

,

а  , получается из

, получается из  путем замены 1-го столбца на столбец

путем замены 1-го столбца на столбец

.

.

Решение может быть сравнительно точно найдено, если матрица системы нормальных уравнений не является плохо обусловленной, т.е. определитель  существенно отличается от нуля. В противном случае, при вычислении

существенно отличается от нуля. В противном случае, при вычислении  ,

,  будет делиться на величину, близкую к нулю. В этом случае необходимо либо менять структуру модели, либо менять выборку экспериментальных данных.

будет делиться на величину, близкую к нулю. В этом случае необходимо либо менять структуру модели, либо менять выборку экспериментальных данных.

Пример: Расчет коэффициентов методом наименьших квадратов.

По опытным данным построить зависимость плотности жидкости от температуры в виде параболы 2-й степени.

Т, К 273 283 293 303

r, кг/м3 875 871 868 867

Для уменьшения расчетов удобно преобразовать переменные так, чтобы они выражались малым числом цифр. Так вместо Т можно использовать величину  ,а вместо r –

,а вместо r –  .

.

Тогда зависимость получит вид:

.

.

Представим опытные данные х и у

x –3 –1 1 3

y 5 1 –2 –3

В первом столбце матрицы плана во всех строках стоят значения  , во втором столбце значения х, в третьем значения х2. Окончательно эта матрица имеет вид:

, во втором столбце значения х, в третьем значения х2. Окончательно эта матрица имеет вид:

.

.

Система нормальных уравнений получится по формуле (8.11)

.

.

Определитель матрицы системы нормальных уравнений

.

.

;

;  ;

;  .

.

Откуда

;

;  ;

;

или

.

.

Окончательно

.

.

При большом числе искомых параметров построение регрессионного уравнения требует громоздких вычислений. В связи с этим в настоящее время построение регрессионных зависимостей практически всегда производится с применением ЭВМ. В этом случае удобно использовать матричный способ представления и обработки информации. Нетрудно убедиться, что матрица коэффициентов левых частей системы равна произведению матрицы  на транспонированную матрицу

на транспонированную матрицу  :

:

. . | (8.12) |

Вектор-столбец правых частей системы нормальных уравнений равен произведению  , где

, где  – вектор (8.4)

– вектор (8.4)

. . | (8.13) |

В матричных обозначениях решение системы (8.11) имеет вид

, , | (8.14) |

где индекс – 1 есть символ обращения матрицы;  – вектор исходных параметров. Это соотношение и используется для нахождения параметров модели.

– вектор исходных параметров. Это соотношение и используется для нахождения параметров модели.

Отметим, что если объект имеет несколько выходных координат, то для каждой выходной координаты ее зависимость от входных переменных находится отдельно.